인간 뉴런의 자극 전달 과정에 아이디어를 착안하여 Machine Learning Algorithm 이 발생하였다. 뉴런은 단순하게 동작이 된다. 인간의 뉴런은 시냅스를 통하여 다른 뉴런으로부터 자극을 전달받고 시냅스를 통하여 다른 뉴런에게 자극을 전달하는 과정을 통해서 학습을 진행한다.

x = 신호(입력값), input

w = 가중치, Weight

b = 편향, Bias

f = 활성화 함수, Activation Function

여러개의 퍼셉트론의 합을 전달해주는 시냅스의 역할은 여러 layer를 잇는 weight/bias(error)가 된다.

들어오는 어떤 신호 input 과 가중치를 곱하여 Bias 를 더한 값이 일정값을 넘어가게 되면 activation(활성화)이 된다.

X1, X2를 Linear하게 100% 구분할 수 없어 정확도가 떨어진다.

Perceptrons

Single neural network는 And, OR 연산은 해결할 수 있지만 XOR 문제는 해결하지 못하였다. Marvin Minsky가 XOR 문제를 풀 수 없음을 수학적으로 증명하였다. 하지만 MLP에서는 여러개를 합친 MLP(multilayer neural nets)을 사용하면 가능하다. MLP 란 여러 개의 퍼셉트론 뉴런을 여러 층으로 쌓은 다층신경망 구조를 말한다. 그러나 또다른 문제는 각각의 w, b 값을 학습 시킬 수 없다는 점이다.

Backpropagation

각각을Artificial Neural Network를 학습시키기 위한 일반적인 알고리즘 중 하나로, 한국말로 직역하면 역전파라는 뜻이다. 내가 뽑고자 하는 target값과 실제 모델이 계산한 output 이 얼마나 차이가 나는지 구한 후 그 오차값을 뒤로 전달해나가면서 각 노드가 가지고 있는 변수들을 갱신하는 알고리즘이다.

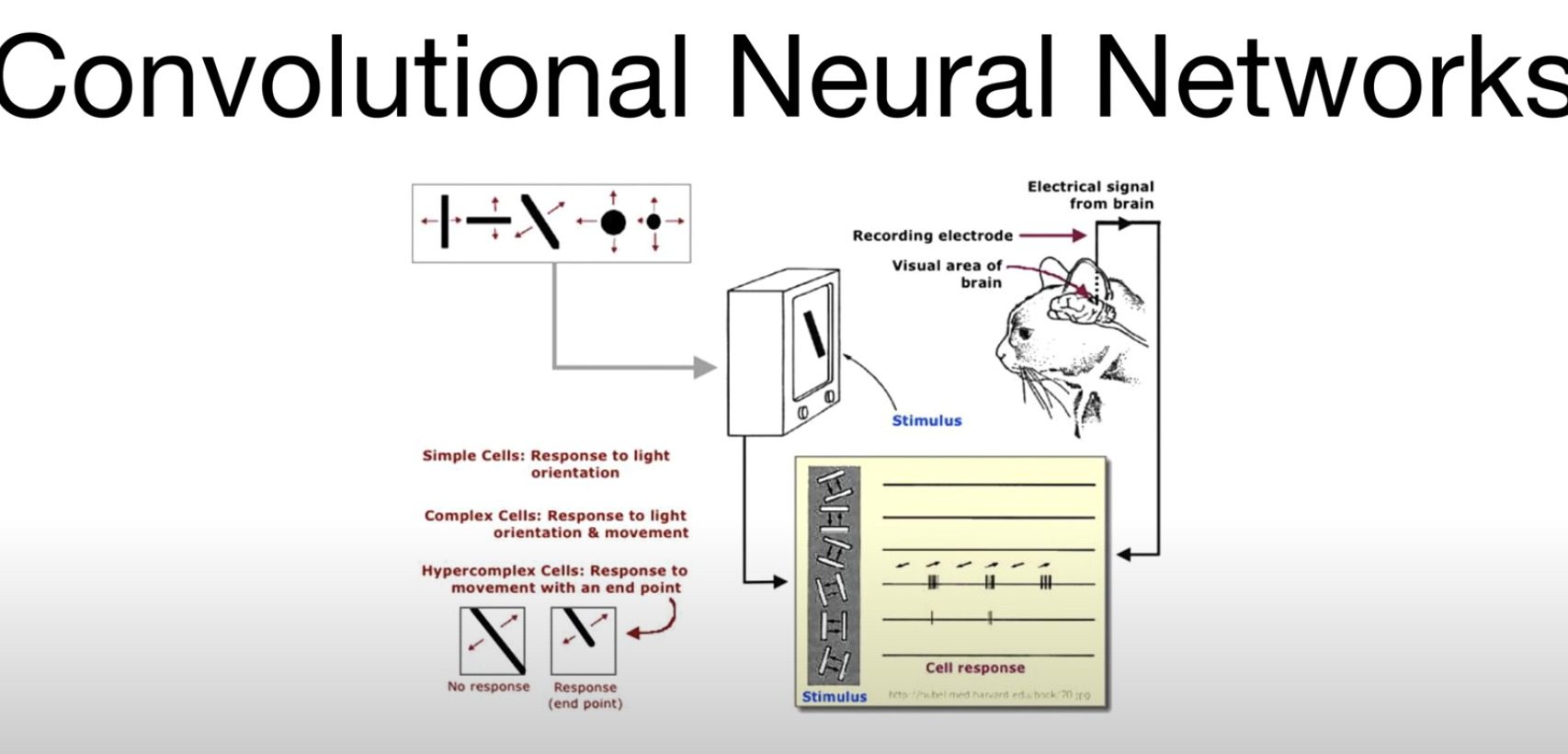

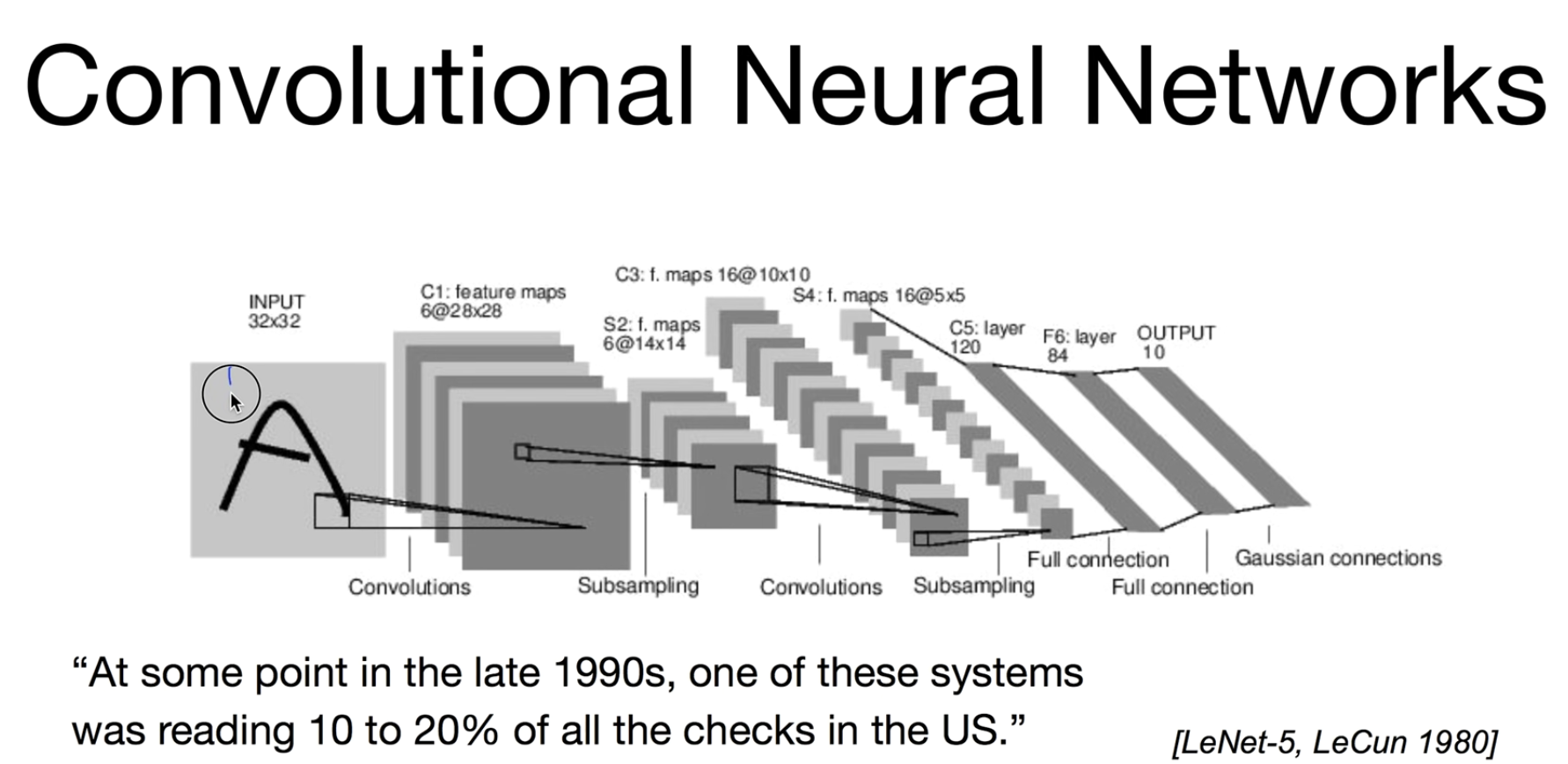

Convolutional Neural Networks

그림볼 때 우리의 전체 신경 세포가 그림을 보는 것이 아니라 일부 뉴런들이 활성화된다는 점을 착안하였다. 한번에 보내면 학습이 복잡해지기 때문에 layer를 잘라서 나중에 합치는 방법을 개발하였다.

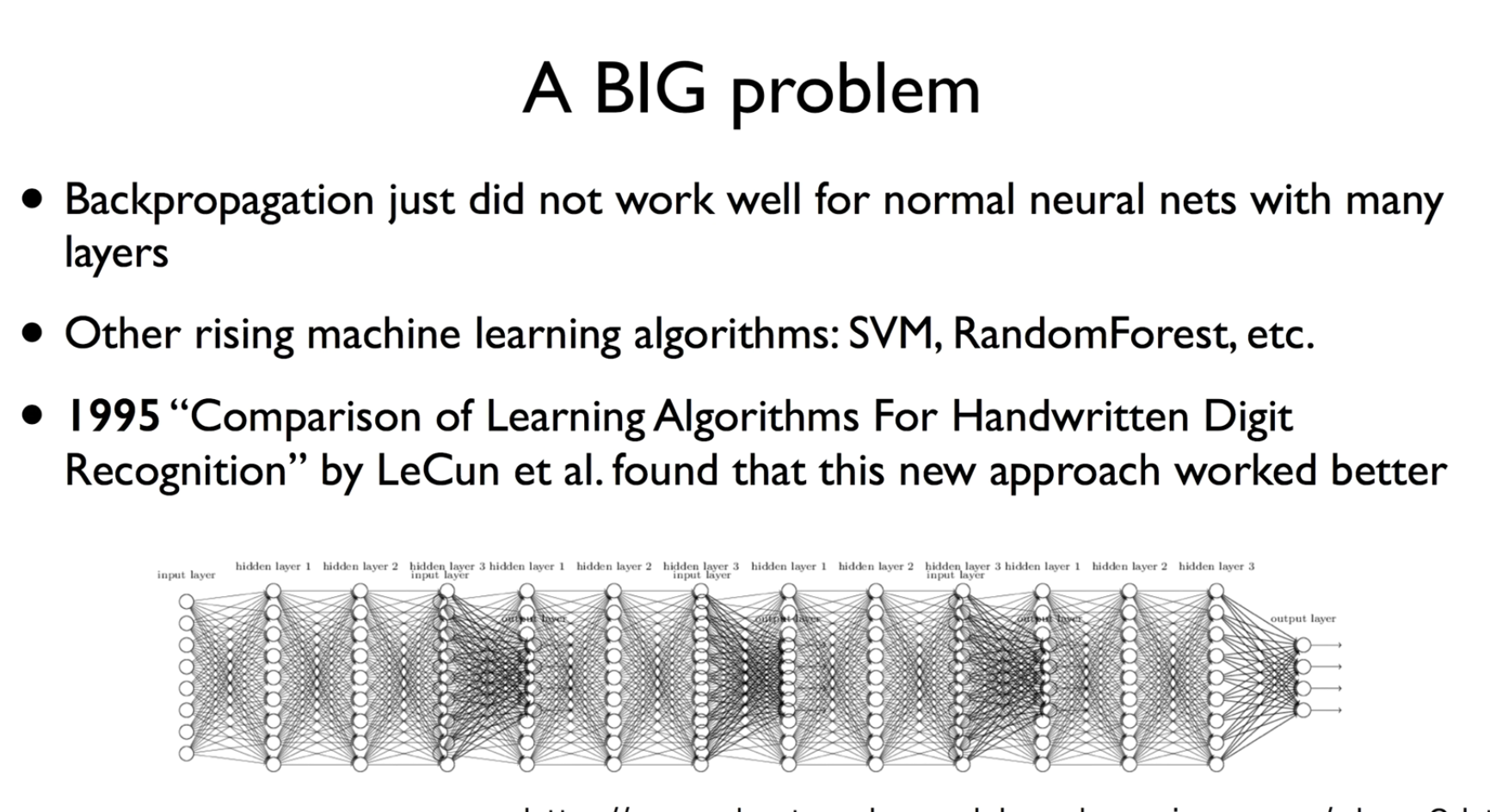

복잡한 문제를 풀기 위해서 10여개 학습이 필요하다. Backpropagation 알고리즘이 많은 수의 레이어를 학습 시킬 경우 갈수록 의미가 약해져서 전달되지 않고 학습을 진행시키지 못한다.

neural network 보다 더 단순한 알고리즘이 발명 : SVM, RandomForestt